Política

Alvo de proibição da Justiça Eleitoral, ferramenta é uma velha conhecida das redes sociais e já foi usada para manipular processos democráticos em outras partes do mundo

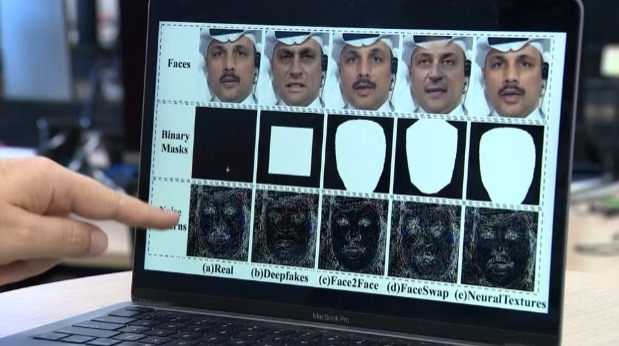

Vídeos em que pessoas aparecem com feições que substituem seus verdadeiros rostos ou com as vozes manipuladas por softwares. As versões são tão convincentes que chegam a enganar quem assiste. Isso pode até parecer uma história contada em ficções científicas, mas não é. O fenômeno tem um nome: "deepfake". Importado da língua inglesa, ele tem sido objeto de preocupação no cenário político nacional.

Embora tenha ganhado escala para o grande público através do noticiário na última terça-feira (27), quando entrou na mira do Tribunal Superior Eleitoral (TSE), a ferramenta já é uma velha conhecida das redes sociais, sobretudo pela utilização em vídeos de humor. Em um movimento que visa coibir o uso irregular do artifício em campanhas eleitorais, a Corte incluiu o assunto em uma das suas resoluções sobre as eleições municipais deste ano.

Na mesma leva, além do veto total às peças falsas, os ministros do TSE também regulamentaram o uso da inteligência artificial (IA) durante a disputa eleitoral, definindo que conteúdos submetidos a esse tipo de tecnologia deverão ser identificados e proibindo que campanhas disponibilizem chatbots e avatares para intermediar a comunicação com pessoas reais. O uso irregular de IA poderá incorrer na perda do mandato por políticos que sejam eleitos.

Ao todo, foram aprovadas 12 resoluções, que ainda não foram publicadas. O teor dos conteúdos sobre os entendimentos jurídicos divulgados até agora são os que já foram expressos pelos membros da instância superior da Justiça Eleitoral, tanto na sessão desta terça-feira quanto na audiência pública, promovida pela Corte em 25 de janeiro e que analisou a minuta de resolução sobre campanha eleitoral agora aprovada.

O QUE É A 'DEEPFAKE'

Doutor em Ciência Política e Sociologia pela Universidade do Estado do Rio de Janeiro (UERJ) e coordenador do Laboratório Hacker da Câmara dos Deputados, o professor Cristiano Ferri explicou, reproduzindo um conceito próprio do TSE sobre o tema, que a "deepfake" é

o conteúdo sintético, em formato de áudio, vídeo ou combinação de ambos, que tenha sido gerado ou manipulado digitalmente, ainda que mediante autorização, para criar, substituir ou alterar imagem ou voz de pessoa viva, falecida ou fictícia".

Questionado sobre o intervencionismo tecnológico nos processos democráticos recentes e a possibilidade de que essas ocorrências demandem outras ações no sentido de legislar a temática ao longo dos próximos anos, o docente disse concordar com a assertiva.

Antes tínhamos, até alguns anos atrás, no começo dos anos 2000, depois de 2010, uma questão quanto a interferência do Estado na regulação das redes sociais. Hoje está muito claro que sim, para alguns pontos, por exemplo, quando envolve a questão política", discorreu.

Essa ideia tem predominado no mundo. Foi o que resultou na regulação, que acabou de sair do forno lá da União Europeia. Embora, claro, haja correntes dizendo que devemos regular o mínimo possível para não coibir as inovações das empresas”, analisou. E prosseguiu: “Mas, nos dias atuais, está muito claro que essas plataformas, as chamadas 'big techs', abrigam uma série de conteúdos e toda uma dinâmica de articulação social que pode, sim, afetar eleições, que pode ter impacto na coisa pública".

O pesquisador enfatizou ainda o poder de convencimento que tem o disparo de informações inverídicas e de conteúdos falsos como os produzidos por meio de “deepfake".

Pode gerar efeitos concretos na cabeça das pessoas e interferir em eleições”, comentou.

COMBATE À DESINFORMAÇÃO

Ferri considera que, nos últimos anos, são perceptíveis os avanços para coibir a desinformação nas eleições, sobretudo na criação de mecanismos como os sistemas de checagem de fatos, a responsabilização das plataformas para atuarem na erradicação de notícias falsas e até mesmo o desenvolvimento de dispositivos por essas empresas para intensificar a tomada de medidas no ambiente online.

Com a inteligência artificial nós vamos ver agora, com essa regulamentação do TSE, que está claro uma co-responsabilização de todos os atores envolvidos: do candidato e do seu partido, das pessoas que criaram, das plataformas que não poderão deixar disseminar conteúdos falsos", destrinchou logo em seguida. O professor esclareceu que uma das novidades de maior destaque é a obrigação de retirada de conteúdos irregulares, independentemente de decisão judicial.

No entendimento de Cristiano, a decisão é "moderna" e foi "muito acertada", pois seguiu todos os trâmites a fim de ampliar o debate com os setores envolvidos e está em consonância com discussões tocadas internacionalmente e que visam a implementação de dispositivos que regulem a inserção das tecnologias na vida cotidiana, não somente na arena política.

Essas decisões do TSE estão na linha dessas regulações novas que estão saindo e que a gente ainda não sabe direito seus efeitos, na prática", interpretou.

Paralelamente, há, no Congresso Nacional, projetos de lei que visam essa regulação de IA de maneira geral. Estão entrando isso aí já faz alguns anos", finalizou Ferri, comentando que a expectativa é que a matéria resulte em uma lei federal ainda este ano.

SISTEMATIZAÇÃO DO QUE JÁ É PROIBIDO

Em síntese, pelo que avaliou Bruno Andrade, coordenador-geral adjunto da Academia Brasileira de Direito Eleitoral e Político (Abradep), a resolução da Justiça Eleitoral sobre o uso de IA não traz nada tão novo assim.

O que tá proibido é o que sempre foi, que é você cometer ilícitos com base na inteligência artificial, fazer abuso do poder, mentir nas campanhas", pontuou o especialista.

Então, o uso permitido da inteligência social tem uma condição que a resolução traz: avisar ao eleitor. É o que a gente chama de rotulagem. Tem que rotular aquela mensagem dizendo recorre à inteligência artificial", continuou. Segundo Andrade, a utilização de "deepfake" também é passível de punição na esfera criminal.

O coordenador da Abradep lembrou, citando dois episódios, que os episódios de casos de uso indevido de IA têm trazido dor de cabeça para políticos em outros países. O primeiro que foi mencionado ocorreu na corrida eleitoral pela presidência da Argentina, em 2023, e colocava o então candidato Sergio Massa em constrangimento. O segundo ocorreu no fim de janeiro, com a divulgação de mensagens falsas envolvendo a voz do presidente dos Estados Unidos, Joe Biden, a fim de trazer vantagem ao seu opositor, Donald Trump.

Em termos jurídicos, salientou o entrevistado, é importante que o Estado regule a aplicação de novidades tecnológicas como a que entrou no raio do Tribunal Eleitoral.

A principal questão é dar segurança jurídica, inclusive para quem está na disputa", argumentou. Para ele, medidas como esta instrumentalizam candidatos e o eleitorado, ao ponto que fornecem mais informações, e dão condições para que irregularidades sejam denunciadas, investigadas e combatidas com uma facilidade maior.

FORMAS DE DENÚNCIA E COIBIÇÃO

Os dispositivos de denúncia incluem a atuação da Polícia Federal, uma vez que crimes eleitorais são de jurisdição federal. Portanto, vítimas de manipulações por IA ou outras situações similares no contexto de eleição devem recorrer à corporação, que irá apurar a situação e, havendo autoria e materialidade, poderá enviar o caso para o Ministério Público, que, por sua vez, encaminhará uma ação para a Justiça Eleitoral.

Plataformas e provedores, ao que indicou o jurista, também devem participar do processo, pela competência que possuem:

Olha, a principal responsabilidade das plataformas, considerando a expertise delas, que é a tecnologia, é fornecer ferramentas para que candidatos, eleitores e o Poder Público consigam mapear essas questões da utilização de inteligência social"

Então, é colocar ferramentas de denúncia, é colocar ferramentas de verificação da rotulagem. Ou seja, é criar mecanismos para que todos os atores envolvidos na disputa consigam verificar essa questão", complementou em entrevista.

Ponto do Poder